AI大模型是什么?

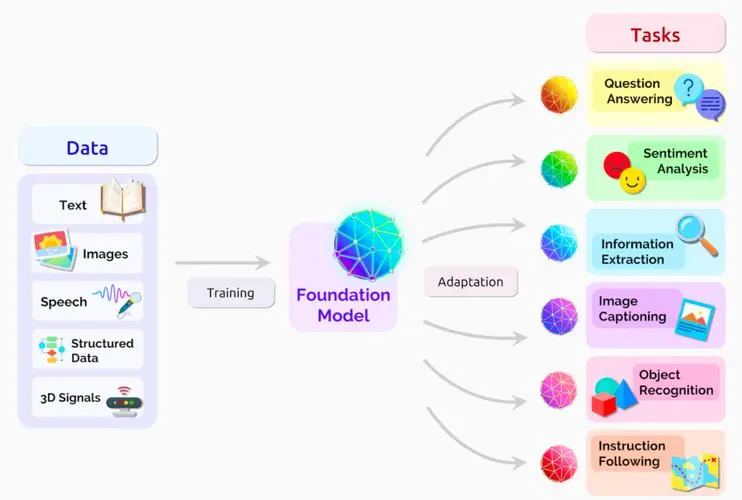

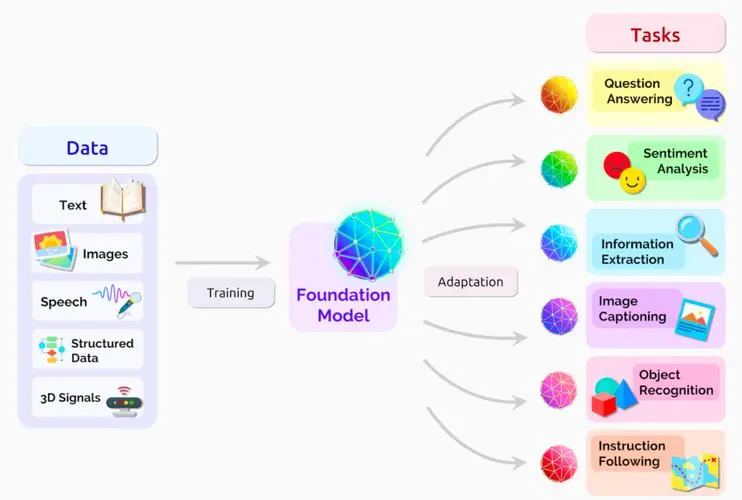

AI大模型,全称“大型人工智能模型”,是指那些具有极其庞大参数规模和复杂结构的人工智能模型,特别是深度学习模型,其参数量可达到数百万乃至数百亿级别。这些模型通常基于神经网络架构,尤其是近年来广泛应用的Transformer架构,比如OpenAI的GPT系列(Generative Pre-trained Transformer)模型、BERT(Bidirectional Encoder Representations from Transformers)模型等。

大模型的特点在于:

大规模训练数据:利用海量的标注或无标注数据进行训练,使得模型能够在大量数据中学习到丰富的模式和规律。

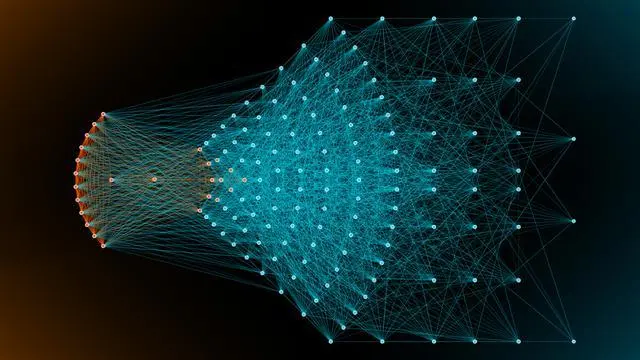

强大的表示学习能力:通过深层神经网络结构捕获数据中的复杂关系和潜在特征,形成高质量的数据表示。

泛化能力强:能在众多不同的下游任务上表现出优秀的迁移学习能力,只需经过少量微调就能适应新场景和新任务。

高计算资源需求:训练和运行这样的模型需要庞大的计算资源,包括GPU集群甚至专门的AI芯片,以及相应的存储设施。

广泛应用:已在自然语言处理(NLP)、计算机视觉(CV)、语音识别等多个领域展现出了卓越的应用效果,如智能问答、文本生成、机器翻译、图像生成、智能推荐等。

随着技术的持续进步,AI大模型不仅在学术界引发了研究热潮,在产业界也推动了诸多产品和服务的创新与发展。

AI模型技术从何而来

AI大模型技术的起源和发展可以追溯到深度学习和神经网络的研究历史。以下是关键的几个发展阶段和技术突破:

神经网络的复兴:20世纪80年代和90年代,反向传播算法(Backpropagation)的普及促进了多层神经网络的研究,但受限于当时计算资源的限制,模型尺寸相对较小。

深度学习的崛起:21世纪初,随着计算能力的提升(例如GPU的广泛使用)和大数据时代的到来,深度学习开始崭露头角。AlexNet(2012年提出的卷积神经网络)在ImageNet图像识别挑战赛中取得突破性成果,标志着深度学习在计算机视觉领域的重要地位确立。

序列建模的进步:RNN(循环神经网络)及其变种LSTM(长短期记忆网络)在解决序列数据问题上取得了进展,尤其是在自然语言处理领域。

Transformer的诞生:2017年,Google Brain团队提出了Transformer架构,这是一种完全基于自注意力机制的新型序列转换模型,极大地提高了对长序列数据建模的能力,为后续的大模型奠定了基础。

大模型的兴起:随后,一系列大模型应运而生,如OpenAI的GPT系列(2018年首次发布GPT-1)和BERT(2018年由Google提出)。这些模型通过大规模数据集预训练,然后在特定任务上微调,展现出前所未有的性能表现。

参数量爆炸式增长:随着时间推移,模型参数数量不断攀升,从最初的几千万到几十亿,再到上百亿,如GPT-3(2020年发布,拥有1750亿参数)和后续更大规模的模型。

综上所述,AI大模型技术是在深度学习框架内,结合了先进的网络架构设计、大规模数据集的使用以及高性能计算能力的不断提升而逐步发展起来的。这一系列技术进步共同促成了现代AI大模型的出现和发展。

原文链接: https://www.yukx.com/aigc/article/details/2454.html 优科学习网AI大模型是什么?

-

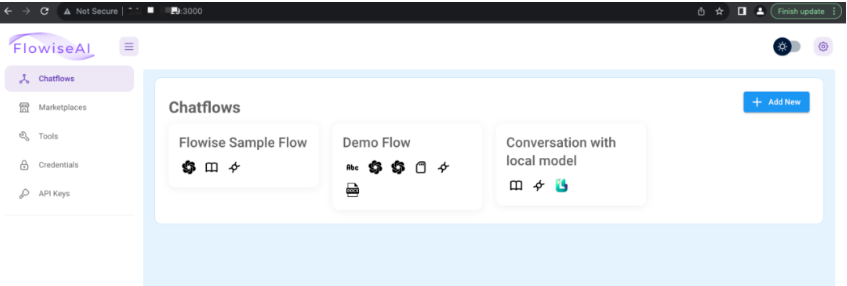

应用开源工具搭建AI大模型涉及多个步骤,以下是一个大致流程,结合上述信息中的开源工具和技术栈:选择开源模型:可以选用已开源的大规模预训练模型,如LLaMA、GPT-3(通过API或部分权重)、ChatGLM3等。环境配置:首先确保本地或者服务器有足够的硬件资源,特别是GPU或者TPU,用于模型推理和

应用开源工具搭建AI大模型涉及多个步骤,以下是一个大致流程,结合上述信息中的开源工具和技术栈:选择开源模型:可以选用已开源的大规模预训练模型,如LLaMA、GPT-3(通过API或部分权重)、ChatGLM3等。环境配置:首先确保本地或者服务器有足够的硬件资源,特别是GPU或者TPU,用于模型推理和 -

AI大模型,全称“大型人工智能模型”,是指那些具有极其庞大参数规模和复杂结构的人工智能模型,特别是深度学习模型,其参数量可达到数百万乃至数百亿级别。这些模型通常基于神经网络架构,尤其是近年来广泛应用的Transformer架构,比如OpenAI的GPT系列(GenerativePre-trained

AI大模型,全称“大型人工智能模型”,是指那些具有极其庞大参数规模和复杂结构的人工智能模型,特别是深度学习模型,其参数量可达到数百万乃至数百亿级别。这些模型通常基于神经网络架构,尤其是近年来广泛应用的Transformer架构,比如OpenAI的GPT系列(GenerativePre-trained -

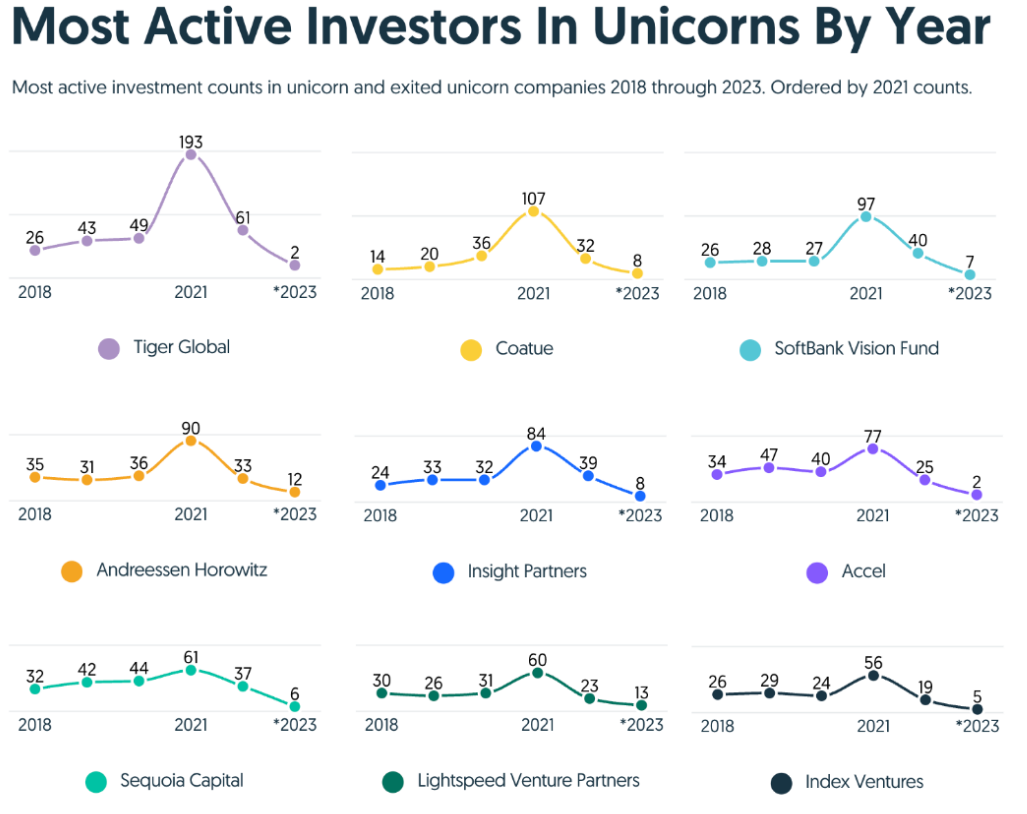

关于AI与创投,来自数十位投资人和CEO的预测1.2023年,独角兽公司的融资大幅下降,仅为2021年市场高峰时的25%左右。2.2023年,全球最活跃的九大VC在独角兽公司的投资大幅下降。这九家投资机构在2023年共投资了44家独角兽公司,占当年所有融资独角兽公司的13%。而在2022年,他们投资

关于AI与创投,来自数十位投资人和CEO的预测1.2023年,独角兽公司的融资大幅下降,仅为2021年市场高峰时的25%左右。2.2023年,全球最活跃的九大VC在独角兽公司的投资大幅下降。这九家投资机构在2023年共投资了44家独角兽公司,占当年所有融资独角兽公司的13%。而在2022年,他们投资 -

建立一个大型预训练语言模型(如文心一言,通义千问,GPT-3或BERT)需要多个步骤和工具。以下是从零开始搭建一个大型预训练语言模型的建议步骤:准备工作:确保有一台计算机或一台服务器可用于运行预训练模型和存储数据。您还需要下载一些额外的软件和库。如果您是从AmazonS3或谷歌云等云服务上托管模型,

建立一个大型预训练语言模型(如文心一言,通义千问,GPT-3或BERT)需要多个步骤和工具。以下是从零开始搭建一个大型预训练语言模型的建议步骤:准备工作:确保有一台计算机或一台服务器可用于运行预训练模型和存储数据。您还需要下载一些额外的软件和库。如果您是从AmazonS3或谷歌云等云服务上托管模型, -

作为一个聊天机器人的系统,chatGPT的架构设计需要满足以下要求:1.可扩展性:系统应该具备较高的可扩展性,能够支持处理大量并发用户请求,并能够快速响应。2.实时性:作为一个聊天机器人,系统需要具备较高的实时性,能够快速响应用户的请求,给用户提供满意的答案。3.精确性:系统需要能够准确地理解用户的

作为一个聊天机器人的系统,chatGPT的架构设计需要满足以下要求:1.可扩展性:系统应该具备较高的可扩展性,能够支持处理大量并发用户请求,并能够快速响应。2.实时性:作为一个聊天机器人,系统需要具备较高的实时性,能够快速响应用户的请求,给用户提供满意的答案。3.精确性:系统需要能够准确地理解用户的 -

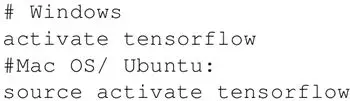

本节将介绍在不同的操作系统(Linux、Mac和Windows)上如何全新安装TensorFlow1.3。首先了解安装TensorFlow的必要要求,TensorFlow可以在Ubuntu和macOS上基于nativepip、Anaconda、virtualenv和Docker进行安装,对于Wind

本节将介绍在不同的操作系统(Linux、Mac和Windows)上如何全新安装TensorFlow1.3。首先了解安装TensorFlow的必要要求,TensorFlow可以在Ubuntu和macOS上基于nativepip、Anaconda、virtualenv和Docker进行安装,对于Wind